โดย Jawad

ในโพสต์บล็อกนี้เราจะสำรวจวิธีการตั้งค่าและเรียกใช้โมเดล Alibaba Cloud Open Source Qwen 0.5 โดยใช้ Ollama และ Open WebUI บน อินสแตนซ์ ECS เมื่อเสร็จสมบูรณ์แล้วเราจะสามารถใช้ความสามารถของโมเดล Qwen ได้ผ่านอินเทอร์เฟซเว็บที่ใช้งานง่าย นี่คือวิดีโอ:

สำหรับการสาธิตแบบง่ายๆ นี้ ผมจะใช้ ecs.g7.large (2 คอร์, RAM 8 GB) อย่างไรก็ตามเมื่อเลือกอินสแตนซ์ ECS โปรดพิจารณาปัจจัยหลักเหล่านี้สำหรับเวิร์กโหลด AI:

• CPU/GPU: มองหาอินสแตนซ์ที่มีจำนวน vCPU สูงกว่าและใช้ GPU เพื่อการคำนวณแบบจำลองที่มีประสิทธิภาพ

• หน่วยความจำ: โมเดลอย่าง Qwen อาจใช้หน่วยความจำมาก ดังนั้นควรใช้หน่วยความจำมากกว่าที่ผมใช้อยู่

• พื้นที่จัดเก็บข้อมูล: พื้นที่จัดเก็บข้อมูลแบบ SSD ช่วยเพิ่มความเร็วในการอ่าน/เขียน ซึ่งเป็นสิ่งสำคัญสำหรับการโหลดโมเดล

• แบนด์วิดท์: ตรวจสอบให้แน่ใจว่าแบนด์วิดท์เพียงพอสำหรับการโต้ตอบที่ราบรื่นผ่าน Open-WebUI

ทำตามขั้นตอนเหล่านี้เพื่อสร้างอินสแตนซ์ของคุณ:

ใช้ SSH เพื่อเชื่อมต่อ:

ssh root@<your-instance-public-ip>อัปเดตและติดตั้ง Docker:

apt update

apt install docker.io

apt install docker-composeสร้างไฟล์ docker-compose.yml โดยใช้ตัวแก้ไข nano หรือ vi:

version: '3.8'

services:

ollama:

image: ollama/ollama

container_name: ollama

volumes:

- ollama:/root/.ollama

ports:

- "11434:11434"

restart: always

open-webui:

image: ghcr.io/open-webui/open-webui:ollama

container_name: open-webui

volumes:

- ollama:/root/.ollama

- open-webui:/app/backend/data

ports:

- "3000:8080"

restart: always

volumes:

ollama:

open-webui:บันทึกเนื้อหาข้างต้นลงในไฟล์ชื่อ docker-compose.yml ในไดเร็กทอรีและบริการที่คุณต้องการโดยใช้:

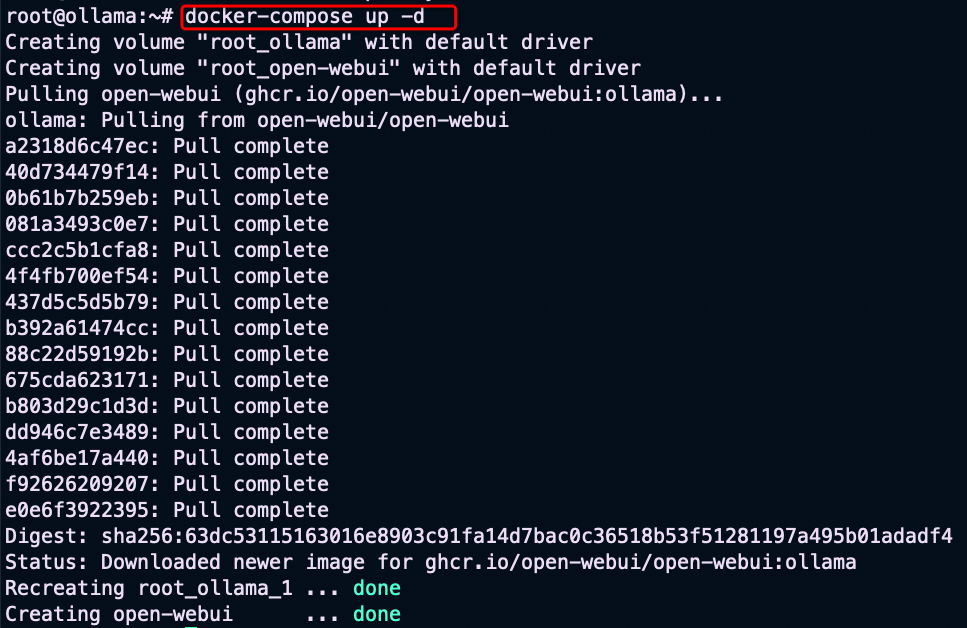

docker-compose up -d

หากต้องการเข้าถึง Ollama Container และดึงโมเดล Qwen 0.5 ก่อนอื่นให้เข้าสู่คอนเทนเนอร์ Ollama โดยพิมพ์ดังนี้:

docker exec -it ollama /bin/bashเมื่ออยู่ในคอนเทนเนอร์แล้วให้ดำเนินการคำสั่งต่อไปนี้เพื่อดึงโมเดล Qwen 0.5:

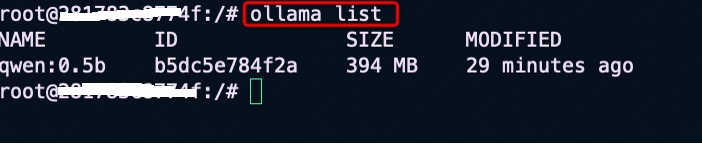

ollama pull qwen:0.5เมื่อเสร็จแล้วตรวจสอบให้แน่ใจว่ามีโมเดล Qwen อยู่ และใช้รายการ Ollama

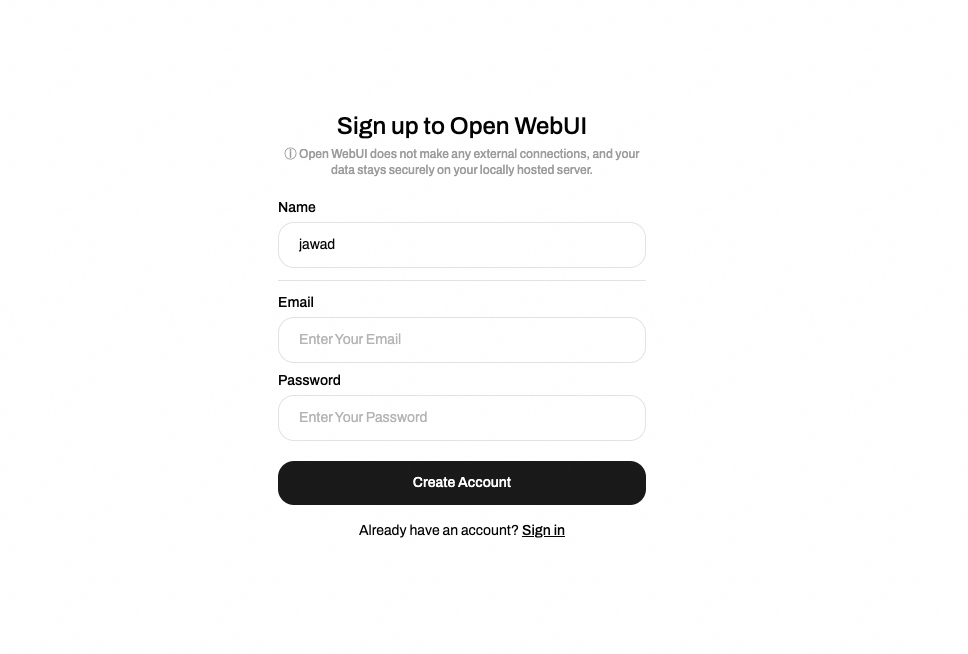

• การเข้าถึงสาธารณะของ ECS: ด้วยกฎ IP สาธารณะและกลุ่มความปลอดภัยที่มีผลบังคับใช้ ใครๆ ก็สามารถเข้าถึง Open-WebUI ของคุณได้โดยไปที่ http://<your-instance-public-ip>:3000 ใช้การสมัครสมาชิกโดยระบุชื่อ อีเมล และรหัสผ่านตามที่แสดงด้านล่าง:

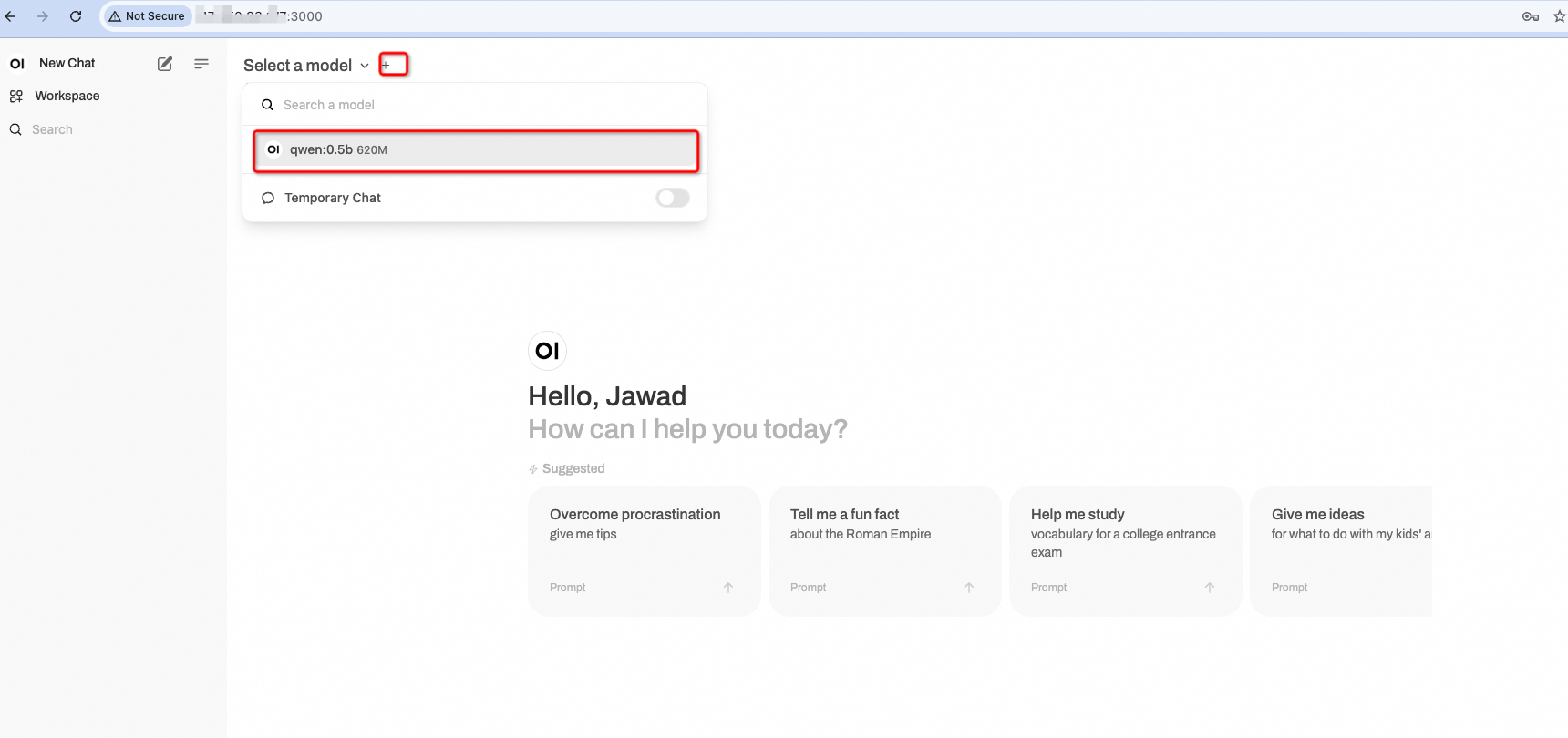

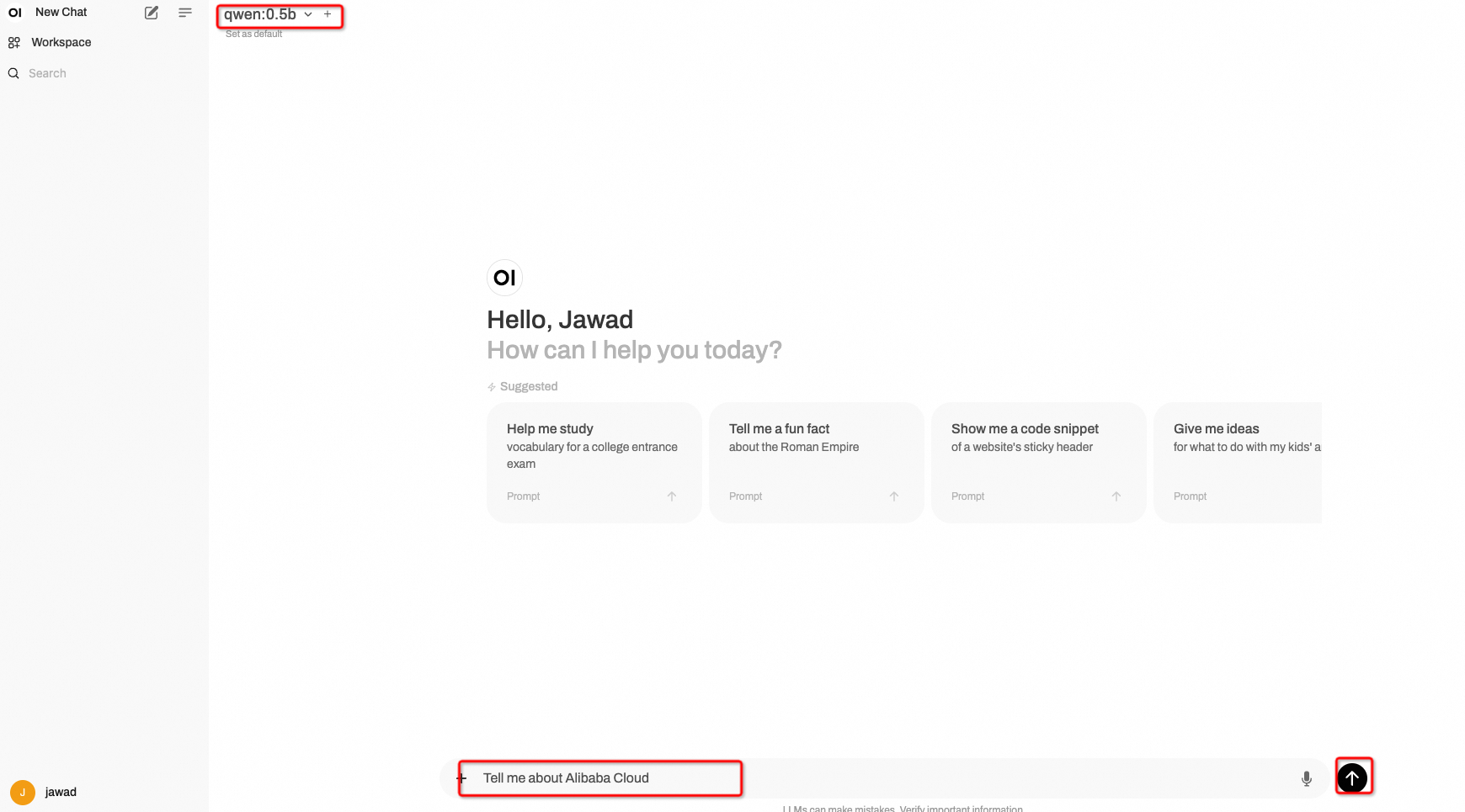

• การใช้งานโมเดล: หลังจากสร้างบัญชีแล้ว ให้โต้ตอบกับโมเดล Qwen:0.5b ของ Alibaba Cloud:

ตอนนี้เราสามารถป้อนพรอมต์ต่างๆ แก่โมเดลเพื่อรับการตอบสนอง:

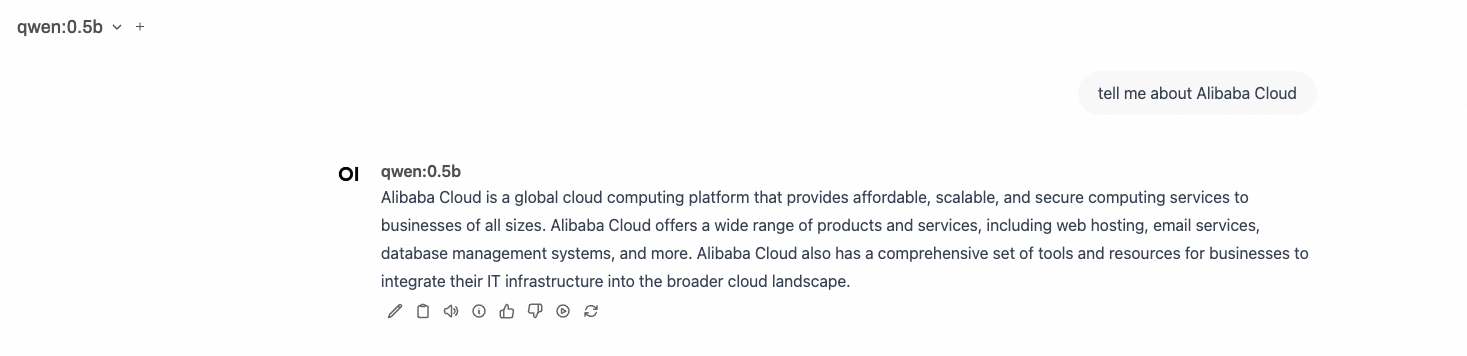

นี่คือผลลัพธ์ของโมเดล:

ตอนนี้คุณได้ตั้งค่า Ollama และ Open WebUI บนอินสแตนซ์ Alibaba Cloud ECS ของคุณสำเร็จแล้ว สามารถดึงโมเดล Qwen 0.5 และเข้าถึงอินเทอร์เฟซเว็บสำหรับการโต้ตอบที่ง่ายดาย การตั้งค่านี้ไม่เพียงช่วยลดความซับซ้อนในการปรับใช้โมเดล แต่ยังช่วยเพิ่มประสบการณ์ของผู้ใช้ด้วยอินเทอร์เฟซที่ใช้งานง่ายอีกด้วย เพลิดเพลินไปกับการทดลองใช้โมเดล Qwen และสำรวจความสามารถของมัน!

สุดท้ายนี้ต้องขอบอกหน่อยว่าหากคุณต้องการคำตอบที่แม่นยำยิ่งขึ้นควรใช้ Alibaba Cloud LLM เช่น Qwen 4b เป็นต้น โดยมีอยู่ใน https://ollama.com/library/qwen ซึ่งอาจต้องใช้ฮาร์ดแวร์ที่มีคุณสมบัติจำเพาะสูงเพื่อให้ได้คำตอบที่ดีกว่า

หากคุณมีคำถามหรือประสบปัญหาใดๆ ก็แสดงความคิดเห็นด้านล่างนี้ได้เลย

บทความนี้แปลจากภาษาอังกฤษ โปรดดูบทความต้นฉบับ ที่นี่

나만의 ChatGPT 구축하기: Alibaba Cloud ECS에서 Qwen을 사용하여 OLLAMA 및 Open-WebUI 배포하기

129 posts | 4 followers

FollowRegional Content Hub - September 18, 2024

Regional Content Hub - May 7, 2024

Regional Content Hub - April 7, 2024

Regional Content Hub - August 12, 2024

Regional Content Hub - July 7, 2025

Regional Content Hub - September 18, 2024

129 posts | 4 followers

Follow Tongyi Qianwen (Qwen)

Tongyi Qianwen (Qwen)

Top-performance foundation models from Alibaba Cloud

Learn More Container Service for Kubernetes

Container Service for Kubernetes

Alibaba Cloud Container Service for Kubernetes is a fully managed cloud container management service that supports native Kubernetes and integrates with other Alibaba Cloud products.

Learn More Alibaba Cloud for Generative AI

Alibaba Cloud for Generative AI

Accelerate innovation with generative AI to create new business success

Learn More Container Compute Service (ACS)

Container Compute Service (ACS)

A cloud computing service that provides container compute resources that comply with the container specifications of Kubernetes

Learn MoreMore Posts by Regional Content Hub